Helm.ai推出VidGen-2生成式人工智能 用于增强自动驾驶视频

盖世汽车讯 生成式人工智能很快就能帮助自动驾驶汽车获得感知能力。人工智能(AI)软件供应商Helm.ai推出其下一代生成式人工智能模型VidGen-2,用于生成逼真的驾驶视频序列。

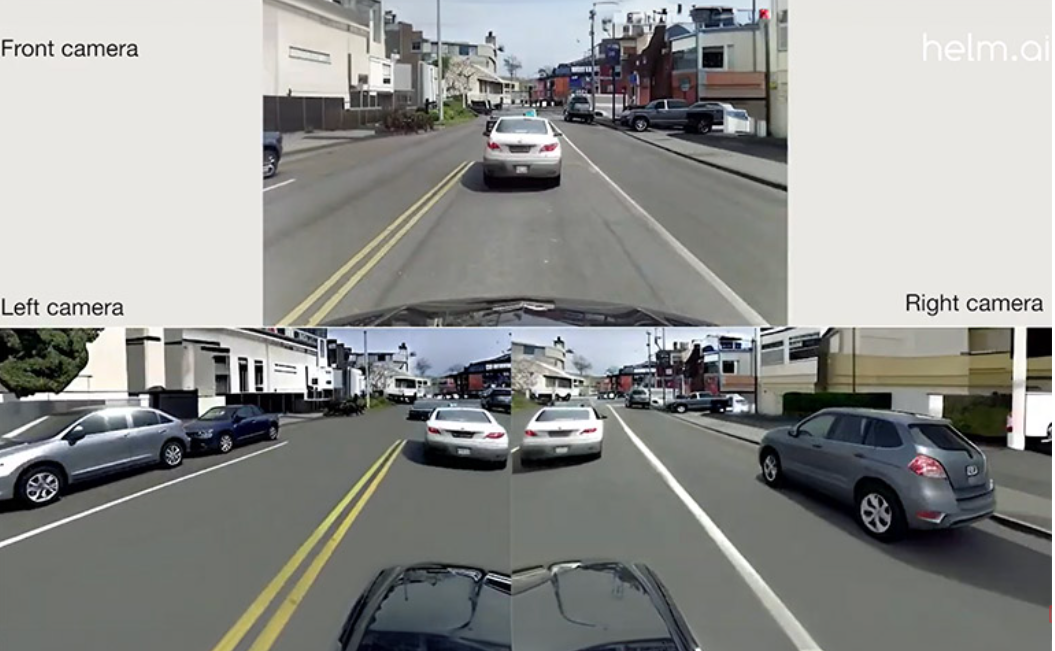

图片来源:Helm.ai

VidGen-2的分辨率是其前身VidGen-1的两倍,每秒30帧的真实感更强,并且支持多摄像头,每个摄像头的分辨率是其两倍。Helm.ai声称为汽车制造商提供了一种可扩展且经济高效的自动驾驶开发和验证解决方案。

VidGen-2提高了视频分辨率

VidGen-2使用英伟达H100 Tensor Core GPU对数千小时的多样化驾驶镜头进行训练,使用Helm.ai的生成深度神经网络(DNN)架构和“深度教学”这种无监督训练方法。它以696 x 696的分辨率生成高度逼真的视频序列,是VidGen-1的两倍,帧速率范围为5到30 fps。

该模型还以30 fps的速度增强了视频质量,从而提供更流畅、更详细的仿真。VidGen-2无需输入提示即可生成视频,或者只需输入单个图像或视频即可生成视频。

VidGen-2还支持多摄像头视图,可从三台摄像头生成每台640 x 384(VGA)分辨率的素材。该公司表示,该模型可确保所有摄像头视角的自一致性,从而为各种传感器配置提供准确的仿真。

Helm.ai称新模型可实现更好的AI驾驶

VidGen-2可生成跨多个地理位置、摄像头类型和车辆视角的驾驶场景视频。该模型不仅可以产生高度逼真的外观和时间一致的物体运动,还可以学习和重现类似人类的驾驶行为,根据交通规则模拟自车和周围主体的运动。

它创建了各种场景,包括高速公路和城市驾驶、多种车辆类型、行人、骑自行车者、十字路口、转弯、天气条件和照明变化。在多摄像头模式下,场景在所有视角中一致生成。

Helm.ai方面表示:“VidGen-2能够快速生成资产,并在模拟中为代理注入复杂的真实行为,为汽车制造商带来了显著的可扩展性优势,优于传统的非AI模拟器。”该公司声称,除了减少开发时间和成本外,其模型还缩小了“模拟到现实”的差距,提供了一种现实而有效的方法来扩大基于模拟的训练和验证的范围。

“VidGen-2的最新增强功能旨在满足汽车制造商开发自动驾驶技术的复杂需求,”Helm.ai联合创始人兼首席执行官Vladislav Voroninski表示。

“这些进步使我们能够生成高度逼真的驾驶场景,同时确保与各种汽车传感器堆栈兼容,”Vladislav Voroninski补充道。“VidGen-2的改进还将支持我们其他基础模型的进步,加速未来自动驾驶和机器人自动化的发展。”

网友评论